Eclosión de la IA

El Parlamento Europeo aprueba definitivamente la ley que regulará la inteligencia artificial

La pionera normativa prohibirá la vigilancia masiva y afectará a modelos de IA generativa como ChatGPT

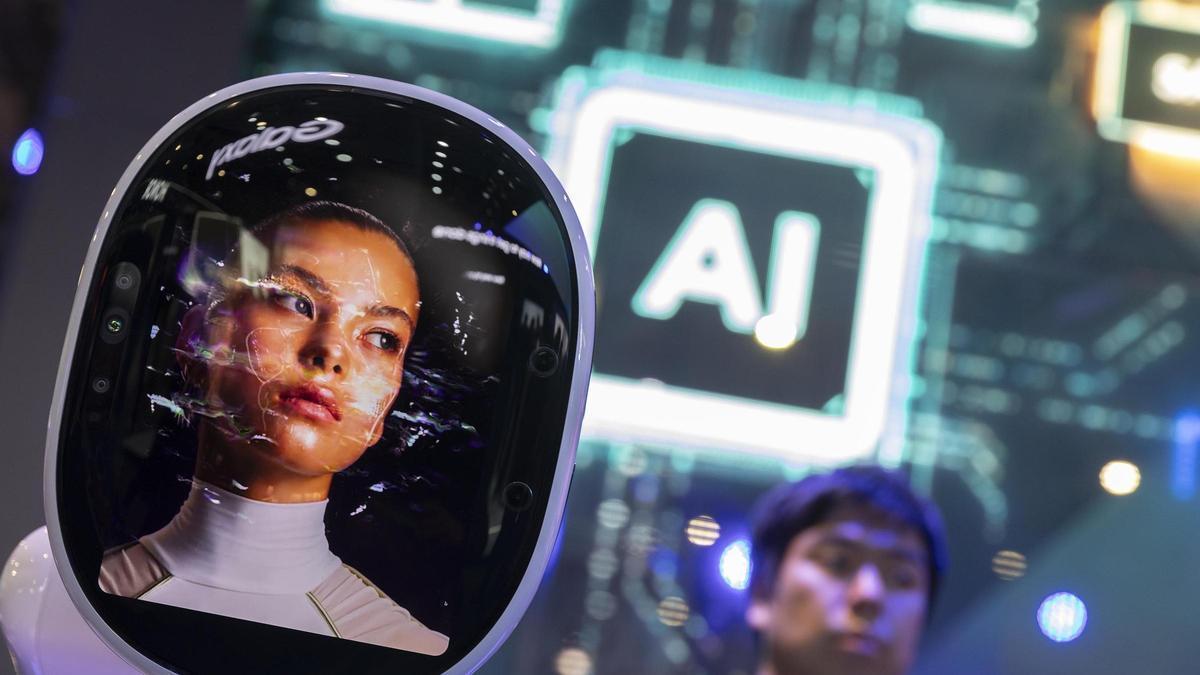

La revolución de la inteligencia artificial se adueña del Mobile. / FERRAN NADEU

Carles Planas Bou

La Unión Europea (UE) contará con la primera regulación integral de la inteligencia artificial (IA) del mundo. Este miércoles, el Parlamento Europeo ha aprobado definitivamente una ley "histórica" que tiene como principal misión limitar los peligros de esta tecnología sin perjudicar la innovación.

El texto aprobado este miércoles por la Eurocámara con una abrumadora mayoría de 523 votos a favor, 46 en contra y 49 abstenciones llega casi tres años después de la primera propuesta de la Comisión Europea. La normativa iba a estar lista a finales de 2022, pero el lanzamiento de ChatGPT y la meteórica popularización de la IA generativa obligó a los legisladores europeos a maniobrar para no dar a luz a un proyecto desfasado.

Uno de los aspectos más debatidos de la ley son las normas impuestas a los modelos de IA de propósito general, los sistemas capaces de generar textos, imágenes o vídeos que han comercializado grandes compañías como Microsoft, OpenAI o Google. Estos deberán aplicar criterios de transparencia que permitan identificar si sus aplicaciones han sido entrenadas con datos que presentan sesgos racistas o machistas o con contenidos que violan los derechos de autor. Y es que cada vez hay más denuncias en ambas direcciones. "Había muchos intereses en juego y nos mantuvimos firmes", ha explicado el eurodiputado Brando Benifei, ponente de la ley. "Vamos a estar muy atentos a una aplicación rigurosa para que los artistas, músicos, editores y otros creativos sientan que sus derechos están defendidos".

Durante meses, Francia lideró las presiones para rebajar estas exigencias, defendiendo así los intereses de la 'startup' gala Mistral AI, un actor de cada vez mayor peso en el sector. El Elíseo aseguró que eso ayudaría a impulsar a las compañías europeas de IA para convertirlas en alternativas a los gigantes tecnológicos de Estados Unidos y así garantizar la soberanía tecnológica de la UE. No solo no lo logró, sino que a finales de febrero Mistral AI anunció su alianza con Microsoft, la empresa con mayor valor en bolsa del mundo.

"Francia tuvo una estrechez de miras gigante", valora el eurodiputado socialista Iban García del Blanco en declaraciones a El Periódico de Cataluña, del grupo Prensa Ibérica. "Si Europa quiere ser relevante en la competición tecnológica internacional debemos tener una estrategia conjunta y cooperativa, se equivocan mucho los países que tratan de ir por su lado". El organismo europeo de control de la competencia está analizando si hubo un conflicto de interés.

Categorización por riesgos

El pasado diciembre, y tras negociaciones de más de 35 horas casi sin interrupción, los eurodiputados sellaron un acuerdo político que da forma a una regulación pionera que categoriza la IA según sus usos y establece obligaciones más o menos estrictas en función de si suponen un "alto riesgo" o un "riesgo mínimo". Las multas por incumplimiento de las normas pueden alcanzar los 35 millones de euros o el 7% de la facturación anual mundial.

De esta manera, la ley prohíbe los sistemas algorítmicos que vulneran derechos fundamentales, como los sistemas de puntuación social, el reconocimiento de emociones, la vigilancia policial predictiva o el rastreo de datos biométricos para inferir la raza, orientación sexual u opiniones políticas de personas.

Exenciones para la policía

Sin embargo, la nueva normativa de la UE también incluye exenciones que han despertado muchas críticas. Es el caso de la IA usada con fines militares o de defensa nacional, que supone una competencia de los Estados miembros, pero también en contextos de vigilancia en las fronteras y para anticiparse a flujos migratorios.

Aunque la identificación biométrica a distancia en espacios públicos está prohibida, la policía podrá recurrir a tecnologías como el reconocimiento facial en situaciones de emergencia como la prevención de una amenaza terrorista, la localización de un menor desaparecido o la identificación de un sospechoso. En todos esos casos será obligatorio contar con una autorización judicial. Benifei ha remarcado que la ley no supone "ningún riesgo de vigilancia masiva" y que el texto está más cerca de la prohibición total que pedía el Parlamento que de lo que pedían los gobiernos europeos.

Denuncia civil

Sin embargo, decenas de organizaciones de la sociedad civil han descrito la ley como un "fracaso" y como una "victoria de la industria". Desde Amnistía Internacional a Access Now, han denunciado que el uso de herramientas "intrínsecamente discriminatorias" socavará "el núcleo de los derechos humanos" y "exacerbará los abusos".

El Comité Europeo de Protección de Datos comparte esa preocupación. El lunes publicó una valoración en la que se mostró "profundamente preocupado" por la "absencia de líneas rojas que prohíban desde el principio las aplicaciones de IA que planteen niveles inaceptables de riesgo" y por una "generalidad" de las obligaciones que "conduciría inevitablemente a una aplicación divergente" de la ley.

Aplicación de la ley

Con el voto de hoy, el Parlamento Europeo rubrica una ley que está llamada a marcar el rumbo tecnológico europeo de la próxima década. "Esto es solo el principio, ahora debemos construir la gobernanza para responder a nuevas cuestiones éticas", ha explicado el eurodiputado y ponente de la legislación, Dragos Tudorache. Está previsto que en los próximos meses se impulsen nuevas regulaciones más específicas, como una sobre el uso de IA en el trabajo.

Aun así, su implementación, definida como "crucial", no será instantánea. Primero, los gobiernos de cada país deberán refrendar el texto. La ley entrará en vigor a los 20 días de su publicación en el Diario Oficial de la UE y será "plenamente aplicable" dos años después. Las prohibiciones tendrán efecto a los seis meses y las obligaciones para los sistemas de IA de propósito general, como ChatGPT, a los 12 meses. Así pues, parte de la ley empezará a aplicarse antes de que finalice el año.

- Un accidente en Guinea deja 15 muertos y 46 heridos

- Caen las aspas del Moulin Rouge en plena noche

- Un tribunal de apelaciones anula la condena de 2020 a Harvey Weinstein por violación

- Hamás recibe la nueva propuesta de tregua de Israel y asegura que la estudiará

- España suministrará a Ucrania misiles Patriot de largo alcance en los próximos días

- Daniel Sancho declarará este jueves en su juicio en Tailandia como estaba previsto

- Guerra de Israel y Gaza, en directo: últimas noticias del conflicto en Oriente Próximo

- Los solicitantes de asilo en la 'cárcel flotante' del Reino Unido: "Te sientes como un prisionero